Gateway LLM : vos SDK OpenAI actuels sont de la dette technique déguisée

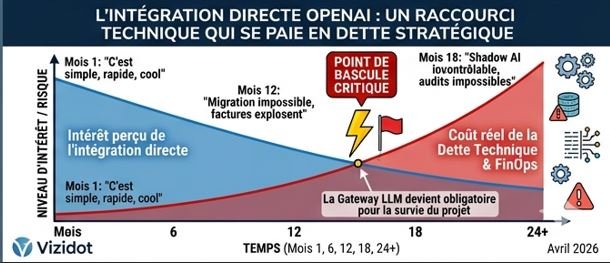

Aujourd’hui, la plupart des équipes appellent directement OpenAI, Claude ou Gemini depuis leurs services. Ça fonctionne. Jusqu’au jour où la facture explose, qu’une clé API fuite, ou qu’il faut migrer de modèle en urgence. Ce n’est pas “simple”. C’est de la dette.

Les entreprises matures en 2026 passent par une gateway LLM : un proxy unique qui centralise les appels, les coûts, la sécurité et le routing des modèles. L’objectif n’est pas d’être “plus cool techniquement”, mais de reprendre le contrôle sur une brique qui impacte directement vos marges et vos risques.

Le problème caché : Shadow AI et facture IA illisible

Sans gateway, chaque équipe parle à son fournisseur préféré, avec son SDK, ses timeouts, ses prompts et ses clés API. Résultat :

- Aucune visibilité par client, produit ou feature sur les coûts IA.

- Aucun contrôle centralisé des modèles, des quotas ou des providers.

- Des intégrations non standardisées, difficiles à maintenir et à auditer.

Vous obtenez ce qu’on appelle du Shadow AI : techniquement impressionnant, financièrement incontrôlable, et impossible à gouverner sérieusement.

Audit Flash Vizidot – SDK spaghetti vs Gateway LLM (10 points)

Chez Vizidot, on évalue l’intérêt d’une gateway LLM avec une grille simple, mais exigeante : 10 critères pour décider si votre architecture est production‑ready ou si elle repose sur de la dette technique maquillées.

1. Performance brute

SDK direct : latence minimale en théorie, mais aucun batching ni cache global. Gateway : légère overhead, compensée par le batching, le caching et des retries mutualisés pour tous les produits.

2. Scalabilité horizontale

SDK direct : chaque microservice doit gérer sa montée en charge IA tout seul. Gateway : un point unique pour gérer QPS, limites, fallbacks et load balancing, ce qui simplifie la montée en charge multi‑produits.

3. Coût opérationnel (Run)

Sans gateway, vous découvrez les dérives à la facture mensuelle. Avec une gateway, vous obtenez une attribution temps réel des tokens par user, équipe ou produit : c’est le socle d’un vrai FinOps IA.

4. Complexité d’implémentation (Build)

Oui, ajouter une gateway, c’est un composant infra supplémentaire. Mais c’est aussi un seul contrat d’API, des clients standardisés, et la suppression de dizaines d’intégrations ad‑hoc disséminées dans vos repos.

5. Robustesse du monitoring / observabilité

En direct, les logs sont éparpillés. Via une gateway, tous les appels LLM sont tracés au même endroit (latence, erreurs, tokens) et prêts à être branchés sur vos outils d’observabilité LLM.

6. Sécurité des données

En direct, les clés sont dupliquées, parfois exposées. La gateway centralise les API keys, applique du RBAC sur les modèles et permet d’inspecter les flux pour limiter les fuites de données sensibles.

7. Dette technique générée

Continuer avec des appels directs, c’est accumuler une dette invisible : chaque nouveau produit IA ajoute sa couche de SDK, de configs et de hacks. Une gateway impose un coût d’entrée, mais stabilise le socle pour les prochaines années.

8. Flexibilité (vendor lock‑in)

SDK direct = dépendance forte à un fournisseur. Une gateway multi‑providers permet de router vers plusieurs LLM et de migrer progressivement sans réécrire tout le code métier.

9. Facilité de déploiement (CI/CD)

Sans gateway, changer de modèle implique des MRs dans plusieurs services et pipelines. Avec gateway, un changement de modèle peut se piloter par une simple mise à jour de configuration versionnée.

10. Impact business réel

L’enjeu n’est pas l’élégance technique. L’enjeu est de passer d’une facture subie à un pilotage par coût par feature et par client, pour savoir où l’IA crée de la marge et où elle en détruit.

Le trade‑off : plus d’infra, mais moins de risques

Une gateway LLM ajoute une surface d’attaque et un point de défaillance supplémentaires. Elle doit être sécurisée, monitorée, maintenue. Mais à partir du moment où plusieurs produits consomment l’IA, ne pas avoir de gateway devient plus risqué (et plus cher) que d’en déployer une.

L’intégration directe “simple” à OpenAI n’est pas une architecture. C’est un raccourci qui se paie en dette technique, en dette FinOps et en dette de conformité quelques mois plus tard.

Quand une gateway LLM devient obligatoire

- Plus d’un produit ou d’une équipe consomme l’IA en production.

- Vous devez arbitrer des budgets IA par client ou business unit.

- Vous avez des contraintes RGPD / AI Act et besoin de logs d’inférence.

- Vous préparez une migration vers des modèles souverains ou self‑hosted.

Si vous cochez déjà deux de ces cases, continuer avec des SDK directs n’est plus un choix technique neutre. C’est un pari risqué sur votre futur coût de maintenance et sur votre capacité à tenir vos promesses clients.

Vous voulez un audit Gateway LLM appliqué à votre stack ?

L’audit infra IA Vizidot analyse vos appels actuels, vos coûts et vos risques, puis vous livre un blueprint de gateway adapté à votre contexte (cloud, volumes, souveraineté).

Passer l’audit infra IAOption Audit Flash 48h – rapport détaillé + blueprints – 490 € HT.